Ridley建模:深度学习与神经网络模型构建秘籍

发布时间: 2025-01-02 20:43:38 阅读量: 43 订阅数: 38

Ridley建模分析

# 摘要

本文是一份综合指南,旨在介绍Ridley建模工具及其在深度学习领域的应用。首先,章节一提供了Ridley建模的入门指导,之后第二章深入讲解了深度学习的基础理论,包括神经网络架构、损失函数、优化算法以及正则化技术。第三章则关注Ridley建模的工具和环境搭建,包括平台的介绍、开发环境的配置、模型部署与测试。第四章通过实战演练,展示了如何在Ridley上构建图像识别、自然语言处理和强化学习模型。第五章探讨了Ridley的高级技巧和最佳实践,以及如何优化模型性能。最后,第六章展望了Ridley社区的资源和深度学习的未来发展趋势。本文旨在为读者提供一个全面的Ridley建模学习路径,以及如何在多个深度学习任务中有效运用该工具。

# 关键字

Ridley建模;深度学习;神经网络;模型部署;正则化技术;性能优化

参考资源链接:[Ridley理论下的DC-DC小信号建模详解](https://wenku.csdn.net/doc/31hre9mis0?spm=1055.2635.3001.10343)

# 1. Ridley建模入门指南

## 1.1 Ridley简介

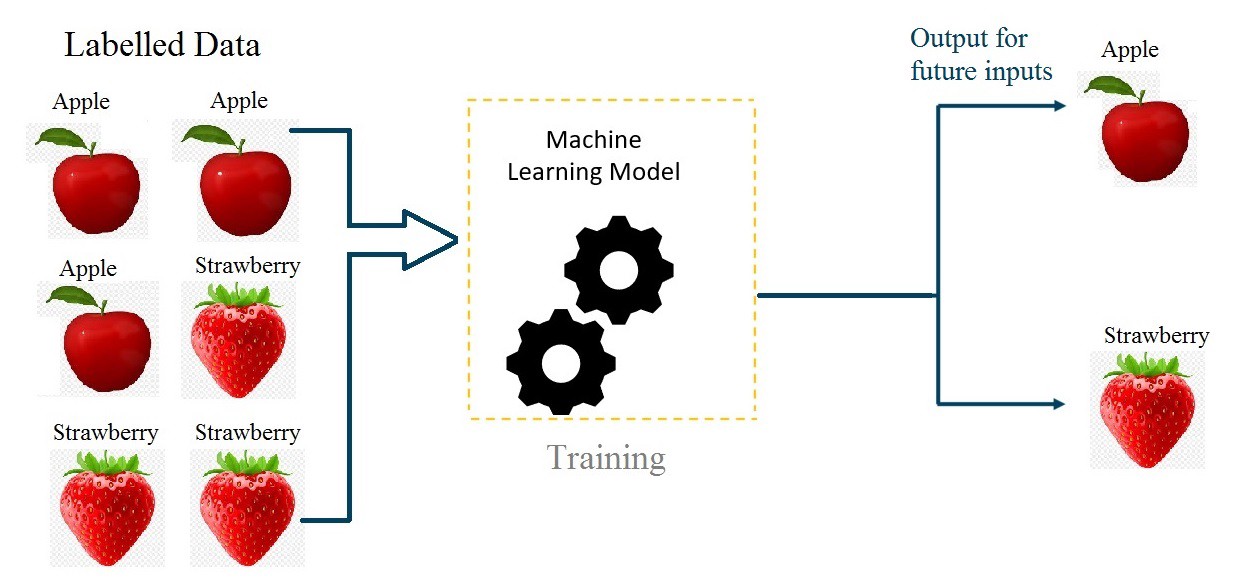

Ridley 是一款先进的机器学习建模工具,它以用户友好的界面和高度的灵活性著称。它允许数据科学家和机器学习工程师轻松地构建复杂的模型,并拥有丰富的算法库和直观的可视化组件。

## 1.2 入门准备

在开始使用Ridley之前,您需要掌握一些基础知识,包括机器学习的基本原理、数据处理技术和编程语言(通常是Python)的使用。此外,了解数据预处理和特征工程将有助于您充分利用Ridley的潜力。

## 1.3 第一个Ridley模型

为了帮助您快速上手,这里介绍如何创建一个基础的分类模型。首先,您需要安装Ridley并导入数据集,然后选择合适的算法构建模型,并进行训练与验证。代码示例如下:

```python

from ridley import Model

from ridley.algorithms import RandomForestClassifier

from ridley.datasets import load_iris

# 加载示例数据集

data = load_iris()

X, y = data.data, data.target

# 初始化模型并设置算法

my_model = Model()

my_model.set_algorithm(RandomForestClassifier())

# 训练模型

my_model.fit(X, y)

# 验证模型

accuracy = my_model.evaluate(X, y)

print(f"Accuracy: {accuracy}")

```

以上步骤展示了Ridley建模的基本流程,帮助您初步了解如何操作这一强大的工具。随着对Ridley掌握的深入,您将能够构建更为复杂和精确的模型。

# 2. 深度学习基础理论

### 2.1 神经网络的基本概念

#### 2.1.1 人工神经元与激活函数

人工神经元是构建神经网络的基本单位,它模仿了生物神经元的某些功能。一个简单的神经元模型包括输入信号、加权求和以及一个激活函数。加权求和是指对输入信号乘以相应的权重,然后求和,这是神经元处理信息的核心部分。激活函数则是在求和的基础上,根据设定的阈值决定神经元是否激活,以及如何输出。

常见的激活函数有Sigmoid、Tanh、ReLU等。Sigmoid函数通常将输入压缩至0和1之间,适用于二分类问题。Tanh函数是Sigmoid函数的变形,将输出范围压缩至-1和1之间。ReLU函数在正区间内输出不变,负区间内输出为零,是目前使用最广泛的激活函数之一,因为它可以缓解梯度消失的问题。

```python

import numpy as np

def sigmoid(x):

"""Sigmoid激活函数"""

return 1 / (1 + np.exp(-x))

def tanh(x):

"""双曲正切激活函数"""

return np.tanh(x)

def relu(x):

"""ReLU激活函数"""

return np.maximum(0, x)

x = np.array([-5, -1, 0, 1, 5])

print("Sigmoid:", sigmoid(x))

print("Tanh:", tanh(x))

print("ReLU:", relu(x))

```

逻辑分析:

在上述代码块中,我们定义了三种激活函数,并对一个包含正负数的数组进行激活处理。Sigmoid函数和Tanh函数将数组中的所有值映射到-1到1之间,而ReLU函数只在正数时输出原值,其余输出为零。

#### 2.1.2 神经网络的类型与结构

神经网络根据其连接方式和数据流向可以分为多种类型,常见的有前馈神经网络、卷积神经网络(CNN)和循环神经网络(RNN)等。

前馈神经网络是一种基本类型的神经网络,在这种网络中,信息只朝一个方向流动,从输入层经过隐藏层,最终到达输出层。CNN通常用于图像处理领域,它能够有效提取图像的特征。CNN的特点是使用了卷积层和池化层,这些层可以捕捉局部特征并进行降维。RNN则适用于处理序列数据,它能够处理不同长度的输入,常用于自然语言处理和时间序列分析。

### 2.2 损失函数与优化算法

#### 2.2.1 常见损失函数的原理和应用

损失函数是衡量模型预测值和真实值之间差异的函数。在训练神经网络时,损失函数用于评估模型的性能,通过最小化损失函数来优化模型参数。常见的损失函数包括均方误差(MSE)、交叉熵损失(Cross-Entropy Loss)等。

均方误差是预测值与实际值差值平方的平均值,主要用于回归问题。交叉熵损失则用于分类问题,其衡量的是两个概率分布之间的差异。交叉熵损失在分类问题中更加高效,因为它对分类错误的惩罚更重,有助于模型更快收敛。

#### 2.2.2 优化算法的选择与对比

优化算法用于更新神经网络的权重,以减小损失函数的值。常见的优化算法包括随机梯度下降(SGD)、Adam、RMSprop等。

SGD是最基础的优化算法,它通过计算损失函数相对于每个参数的梯度,并用这个梯度来更新参数。Adam算法是SGD的一个变种,它结合了动量(Momentum)和学习率自适应的概念,使得训练过程更加稳定。RMSprop同样对学习率进行调整,以避免训练过程中的大幅震荡。

### 2.3 正则化与模型泛化

#### 2.3.1 过拟合与欠拟合

过拟合是指模型在训练集上表现良好,但对未见过的数据泛化能力差,即模型学习了训练数据中的噪声和细节,而没有捕捉到数据的真正分布。欠拟合则是模型对训练数据的拟合程度不足,导致模型性能不佳。

为了解决过拟合问题,可以通过减少模型复杂度、增加数据量、使用正则化等技术。正则化通过在损失函数中加入额外的项(如L1和L2正则化项),来约束模型的复杂度,从而避免过拟合。

#### 2.3.2 正则化技术的实现和效果

正则化技术,如L1和L2正则化,可以有效防止模型过拟合。L1正则化倾向于产生稀疏的权重矩阵,有助于特征选择;而L2正则化则使权重尽量小且分散,防止某些参数过大而导致过拟合。

通过在损失函数中添加正则化项,可以控制模型复杂度,使得模型在保持学习到的特征的同时,不至于对训练数据过度拟合。实践中,通常需要通过交叉验证来选择合适的正则化强度。

### 章节总结

通过本章节的介绍,我们详细解析了神经网络的基本概念、不同类型的神经网络、损失函数的选择及其应用,以及优化算法的原理和正则化技术的效果。这些基础知识构成了深度学习的理论基石,为后续章节中具体的Ridley建模实战演练和进阶技巧的学习打下了坚实的基础。在下一章节中,我们将深入探索Ridley建模工具的使用和环境搭建,这是实操中不可或缺的步骤。

# 3. Ridley建模工具与环境搭建

## 3.1 Ridley建模平台概述

### 3.1.1 Ridley的功能与特点

Ridley是一个功能强大的机器学习和深度学习建模平台,提供了多种工具和接口以辅助开发人员和数据科学家快速搭建、测试和部署复杂的模型。Ridley的核心特点包括:

- **易用性**: Ridley通过直观的可视化界面和代码生成器减少了开发者的编码工作量,即使非专业程序员也能快速上手。

- **灵活性**: Ridley支持多种深度学习框架(如TensorFlow、PyTorch等)的集成,允许用户选择最适合其

0

0